Cette page est une traduction automatique. Pour les informations de référence, consultez la version anglaise.

Évaluation des agents

Testez vos agents IA de manière systématique avec des jeux de questions. Lancez des évaluations, suivez les résultats dans le temps et identifiez les opportunités d'amélioration pour garantir des réponses fiables.

Qu'est-ce que l'évaluation des agents ?

L'évaluation des agents vous aide à tester comment votre agent répond à un grand nombre de questions.

Utilisez-la pour :

- L'assurance qualité avant de lancer votre agent

- Identifier les domaines où votre agent doit s'améliorer

- Les tests de régression après des modifications de votre base de connaissances

- Mesurer les performances de l'agent dans le temps

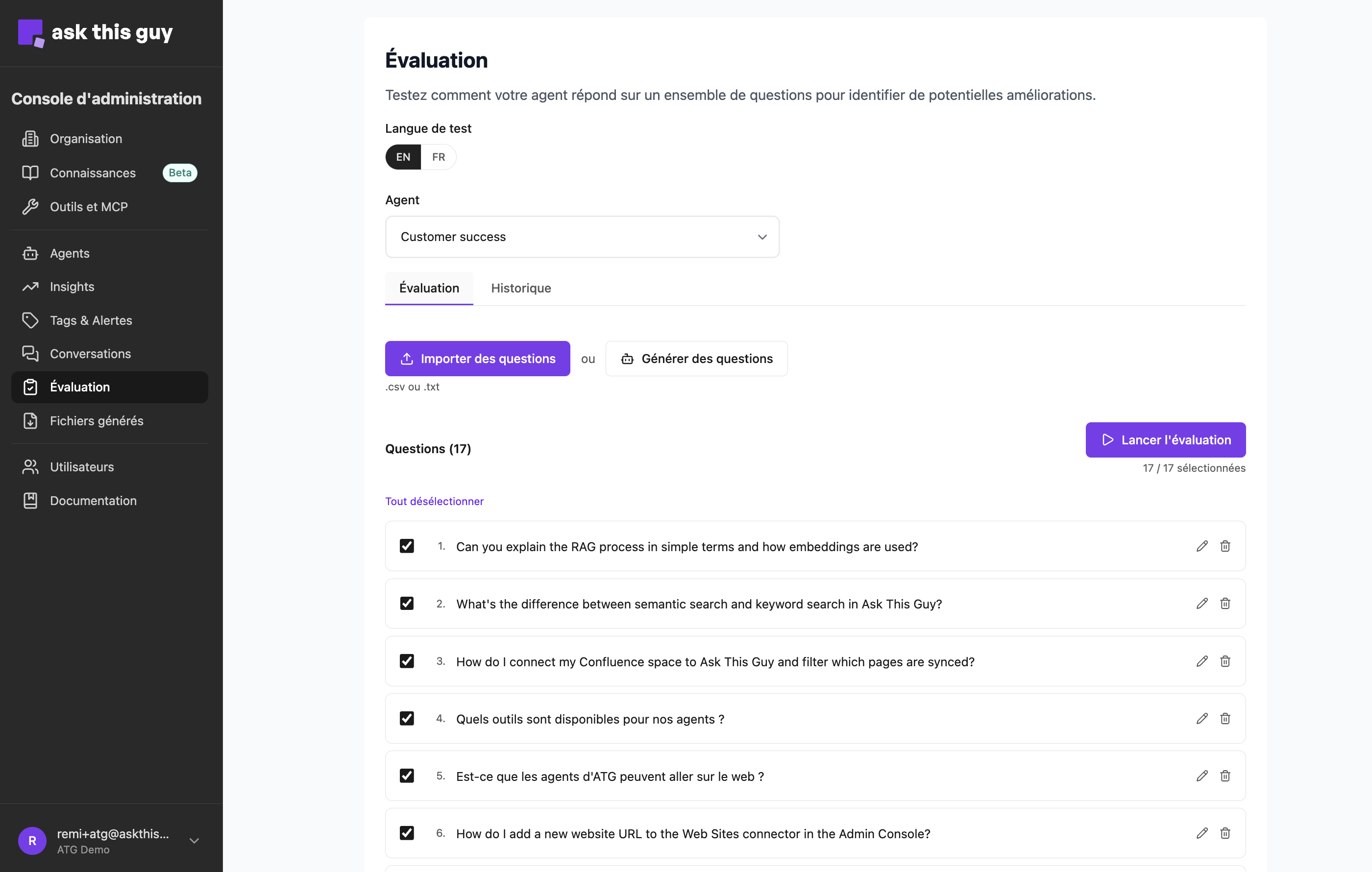

Interface d'évaluation des agents

Interface d'évaluation des agents

Pour commencer

1. Sélectionner un agent

Choisissez l'agent que vous souhaitez évaluer dans le menu déroulant Agent en haut de la page.

2. Choisir la langue de test

Sélectionnez la langue pour vos questions de test :

- EN - Anglais

- FR - Français

Vos jeux de questions en anglais et en français sont séparés et l'agent répondra dans la même langue que la question.

Ajouter des questions

Vous pouvez :

- saisir vos questions manuellement

- importer un fichier de questions

- demander à la plateforme de générer des questions pour vous

Importer des questions

Formats supportés : fichiers CSV ou TXT

- Cliquez sur Upload Questions

- Sélectionnez un fichier

.csvou.txtdepuis votre ordinateur - Les questions doivent être une par ligne/rangée

- Pour les fichiers CSV, utilisez uniquement la première colonne (supprimez les colonnes supplémentaires)

- Si votre question existe déjà dans votre jeu, elle ne sera simplement pas ajoutée pour éviter les doublons

Notes importantes :

- Maximum 50 questions par exécution de test

- Si vous importez depuis un tableur (Excel, Numbers), exportez d'abord en CSV

- Les fichiers sont automatiquement enregistrés dans votre jeu de questions

Option B : Générer des questions

Laissez le système générer automatiquement des questions à partir de la base de connaissances de votre agent :

- Cliquez sur Generate Questions

- Choisissez le nombre de questions (5-50)

- Sélectionnez les types de contenu à inclure (documents, fichiers, sources web)

- Examinez les questions générées

- Sélectionnez celles à conserver et cliquez sur Add Selected

Pour vous donner une image complète des performances de votre agent, la fonctionnalité d'évaluation génère un mélange de questions pertinentes et hors sujet. Cela vous aide à voir comment votre agent gère les requêtes qui sortent de son domaine prévu.

Gérer votre jeu de questions

Une fois que vous avez chargé des questions, vous pouvez :

- Sélectionner/désélectionner des questions avec les cases à cocher (seules les questions sélectionnées seront exécutées)

- Modifier le texte d'une question en cliquant dessus

- Supprimer les questions dont vous n'avez pas besoin

- Ajouter de nouvelles questions manuellement avec le bouton "+ Add Question"

Télécharger les questions

Exportez vos questions sous forme de fichier CSV avec le bouton Download Questions. Utile pour :

- Sauvegarder votre jeu de questions

- Partager avec les membres de l'équipe

- Modifier en masse dans un tableur

Lancer des tests

Démarrer un test

- Assurez-vous d'avoir des questions sélectionnées (cases cochées)

- Cliquez sur le bouton Run Test

- Suivez la progression en temps réel à mesure que chaque question reçoit une réponse

- Les résultats apparaissent un par un au fur et à mesure qu'ils sont terminés

Maximum : 50 questions par exécution Vous ne pouvez lancer qu'une seule évaluation à la fois pour un agent spécifique dans votre organisation.

Pendant l'exécution du test

Vous verrez :

- Barre de progression indiquant l'état d'avancement

- Résultats en direct apparaissant au fur et à mesure que chaque question est terminée

- Temps d'exécution pour chaque réponse

- Indicateurs de succès/échec

Arrêter un test en cours

Si vous devez arrêter un test avant la fin :

- Cliquez sur le bouton Stop dans la zone de progression

- Attendez que le système arrête le traitement en toute sécurité

- Les résultats partiels seront conservés

Comprendre les résultats

Pour chaque paire question-réponse

Cliquez sur n'importe quelle question pour l'agrandir et voir :

Détails de la réponse :

- Réponse complète de l'agent (avec formatage markdown)

- Temps d'exécution (temps nécessaire pour générer)

- Outils utilisés (recherche, récupération de documents, etc.)

- Sources citées (documents ou pages web)

Options de feedback :

- Pouce levé - Bonne réponse

- Pouce baissé - Réponse problématique (ajoutez des détails sur les raisons)

Détails du feedback

Lorsque vous marquez une réponse comme négative, vous pouvez ajouter des notes spécifiques :

- Ce qui n'allait pas avec la réponse

- Ce que vous attendiez à la place

- Les schémas que vous remarquez

Ce feedback vous aide à identifier :

- Les lacunes de connaissances de votre agent

- Les questions qui nécessitent de meilleures données d'entraînement

- Les schémas d'échec courants

Exporter les résultats

Téléchargez les résultats des tests au format CSV avec le bouton Download Results.

L'export comprend :

- Texte de la question

- Réponse de l'agent

- Statut de succès/échec

- Temps d'exécution

- Messages d'erreur (le cas échéant)

- Notes de feedback

Onglet Historique

Voir les exécutions de tests passées

Basculez vers l'onglet History pour voir toutes les évaluations précédentes :

Vue liste des exécutions :

- Date et heure de chaque exécution

- Statut (Terminé, Arrêté, En cours, Erreur)

- Total de questions testées

- Comptages de succès/échec

Vue détails de l'exécution :

- Cliquez sur n'importe quelle exécution pour voir les résultats détaillés

- Agrandissez les paires question-réponse individuelles

- Ajoutez du feedback aux réponses passées

- Exportez les résultats d'une exécution spécifique au format CSV

Pagination

- Liste des exécutions : 10 exécutions par page

- Détails de l'exécution : 50 résultats par page

Utilisez les contrôles de pagination en bas pour naviguer dans les jeux de résultats plus larges.

Bonnes pratiques

Créer des jeux de questions efficaces

- Couvrez différents sujets de votre base de connaissances

- Incluez des cas limites et des questions délicates

- Mélangez questions simples et complexes

- Testez les requêtes courantes des utilisateurs

Planning de tests réguliers

Envisagez de lancer des évaluations :

- Avant les versions majeures ou les mises à jour

- Après l'ajout de nouveau contenu à la base de connaissances

- Lorsque les utilisateurs signalent des problèmes sur des sujets spécifiques

- Mensuellement pour le suivi de la qualité

Dépannage

"Maximum de 50 questions atteint"

Vous avez sélectionné trop de questions. Décochez certaines questions ou divisez en plusieurs exécutions de tests.

"Test déjà en cours"

Un autre test est en cours. Attendez qu'il se termine ou arrêtez-le d'abord.

Erreurs d'import de fichier

"Type de fichier invalide"

- Utilisez uniquement des fichiers

.csvou.txt - Si vous utilisez un tableur, exportez en CSV

"Plusieurs colonnes détectées"

- Supprimez toutes les colonnes sauf la première (questions)

- Ou enregistrez en texte brut (.txt) avec une question par ligne

"Aucune question trouvée"

- Vérifiez que votre fichier n'est pas vide

- Assurez-vous que chaque ligne contient du texte

Impossible de voir les résultats

Si un test est en cours mais que vous ne voyez pas les résultats :

- Vérifiez l'onglet History

- Cherchez l'exécution en cours

- Cliquez sur Reconnect pour reprendre la visualisation des résultats en direct

Limites et contraintes

- Questions max par exécution : 50

- Questions max stockées : 100 par agent

- Taille de fichier : fichiers CSV/TXT de taille raisonnable uniquement

- Exécutions simultanées : un test par agent à la fois